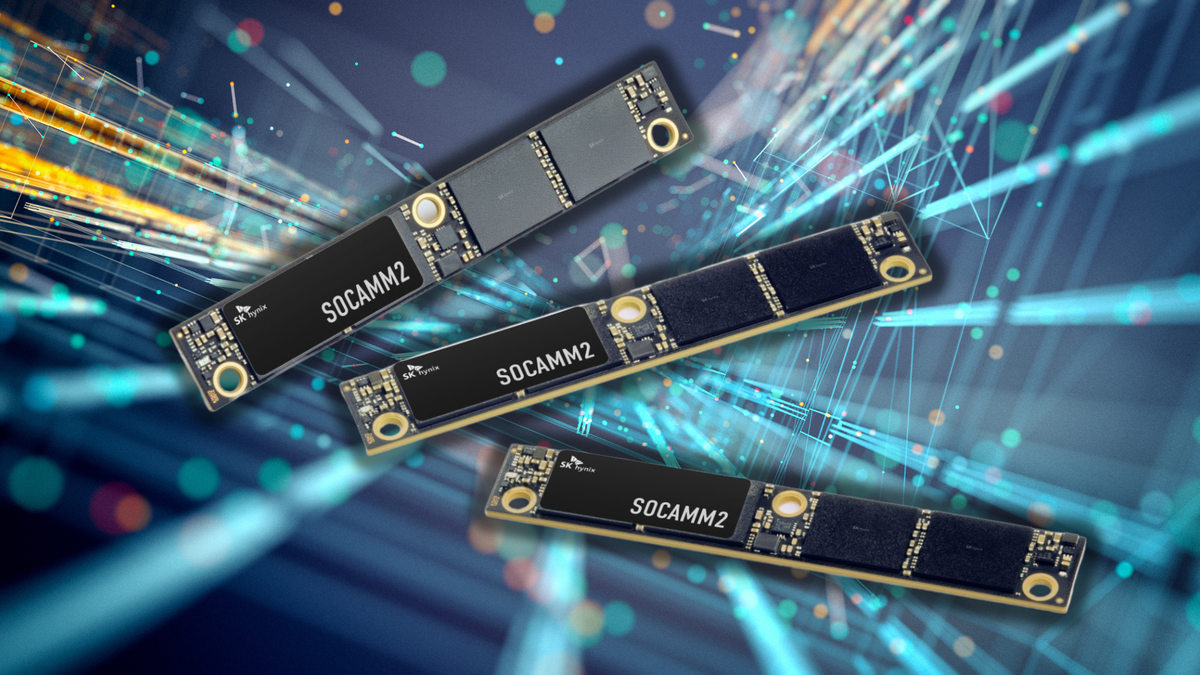

SK hynix inicia produção de memórias SOCAMM2 de 192 GB para chips de IA da NVIDIA

Novos módulos otimizados para servidores prometem alta densidade e eficiência térmica para as futuras GPUs Rubin e CPUs Vera.

192 GB de memória em um único módulo. Esse é o novo patamar que a SK hynix acaba de estabelecer para o mercado de servidores.

A fabricante anunciou o início da produção em massa de suas memórias SOCAMM2. Elas são focadas em Inteligência Artificial.

Mas por que isso é um marco para a indústria de hardware agora?

O que muda para você

> "O SOCAMM2 é o Server Optimized CAMM2, uma evolução direta do padrão que surgiu em notebooks entusiastas."

Essa tecnologia traz para os data centers uma modularidade que antes era difícil de alcançar com alta performance. A grande diferença aqui é o foco total em servidores de IA.

Nesses ambientes, o espaço físico e a eficiência térmica são tão críticos quanto a velocidade bruta dos dados. O SOCAMM2 resolve o problema de densidade sem sacrificar o resfriamento.

Do notebook para o servidor

O padrão CAMM2 foi criado originalmente para economizar espaço em laptops finos. Ele substitui os tradicionais slots SO-DIMM.

Agora, a SK hynix adaptou essa ideia para o ambiente de alto desempenho. Isso permite que servidores tenham muito mais memória em menos espaço.

Por que isso importa agora

A produção está ligada ao cronograma das novas arquiteturas da NVIDIA. Estamos falando das futuras CPUs Vera e GPUs Rubin.

Esses chips de próxima geração precisam de uma quantidade gigantesca de memória. Só assim eles conseguem lidar com modelos de linguagem (LLMs) complexos.

As arquiteturas Vera e Rubin

A arquitetura Rubin é a sucessora da Blackwell. Ela promete saltos imensos em capacidade de processamento para modelos generativos.

Já a CPU Vera foca em eficiência energética. Juntas, elas formam a espinha dorsal dos futuros supercomputadores de empresas como Microsoft e Google.

> "Essa é a maior aposta da NVIDIA para manter a liderança absoluta no mercado de processamento de alto desempenho."

O fim do "gargalo térmico"

Diferente dos módulos DIMM tradicionais que ficam "em pé", o SOCAMM2 usa um design horizontal. Ele se conecta diretamente à placa-mãe (PCB).

Isso reduz a latência de forma significativa. Além disso, o formato "flat" facilita muito o fluxo de ar dentro dos racks.

Design horizontal e fluxo de ar

Em um servidor comum, os módulos de memória verticais funcionam como barreiras. Eles impedem que o ar frio chegue aos processadores.

Com o SOCAMM2, o caminho fica livre. Isso ajuda a amenizar o calor, que é o maior inimigo da computação moderna.

Os números que chamam atenção

A SK hynix não está sozinha nessa corrida. Gigantes como Samsung e Micron também estão no jogo para suprir a demanda da NVIDIA.

Confira as principais especificações e destaques dessa tecnologia:

- Capacidade SK hynix: 192 GB por módulo individual

- Capacidade máxima (Micron): Até 256 GB por módulo

- Interface: Conexão direta ao PCB para menor latência

- Foco de mercado: Data centers de IA e processamento em nuvem

- Clientes principais: NVIDIA, AMD e Qualcomm

Um breve olhar para o passado

Para entender o SOCAMM2, precisamos olhar para a história da memória RAM. Durante décadas, o padrão DIMM dominou os servidores.

Ele era confiável, mas ocupava muito espaço vertical. Com a explosão da IA em 2023, a indústria percebeu que precisava de algo novo.

> "A densidade que vemos hoje era impensável para soluções não-HBM até pouco tempo atrás."

As memórias HBM (High Bandwidth Memory) continuam sendo as mais rápidas. Porém, elas são muito caras e difíceis de produzir em massa.

O SOCAMM2 surge como um meio-termo ideal. Ele oferece alta densidade com um custo de produção mais controlado que as memórias HBM.

A disputa pelo topo do mercado

A NVIDIA está trabalhando com todas as gigantes do ramo. O objetivo é garantir que não falte componente para as Big Techs.

Embora a SK hynix tenha iniciado a produção agora, a concorrência é feroz. A Micron, por exemplo, já anunciou módulos de 256 GB.

Micron e a barreira dos 256 GB

A Micron detém atualmente a maior densidade anunciada no formato SOCAMM2. Isso coloca pressão sobre a SK hynix e a Samsung.

A Samsung também está comprometida com a fabricação de DRAM para o "Time Verde". Essa disputa beneficia diretamente o desenvolvimento de IAs mais potentes.

O veredito

O início da produção da SK hynix marca o fim de uma era de limitações físicas nos servidores. O hardware está finalmente alcançando a demanda do software.

Não é apenas sobre ter mais memória. É sobre como essa memória permite que a IA evolua sem derreter os data centers.

Se esse ritmo continuar, em 6 meses o cenário de infraestrutura de IA vai ser irreconhecível.

Qual dessas mudanças tecnológicas você acha que vai impactar mais o mercado brasileiro?

Redação SWEN

Equipe Editorial

A equipe SWEN é formada por especialistas em Inteligência Artificial e tecnologia, trazendo as notícias mais relevantes do setor com análises aprofundadas e linguagem acessível. Nossa missão é democratizar o conhecimento sobre IA para todos os brasileiros.