META planeja monitorar funcionários para treinar modelos de IA

A META pretende capturar as teclas e cliques dos funcionários ao usar sites como Google, LinkedIn e Wikipedia para treinar seus modelos de IA. Isso será feito através de uma ferramenta de rastreamento chamada Model Capability Initiative (MCI).

Esqueça as câmeras de segurança tradicionais ou o controle de ponto biométrico. A Meta está prestes a transformar o escritório em um grande laboratório de dados em tempo real, onde cada clique, linha de código e conversa de corredor serve de combustível para a inteligência artificial.

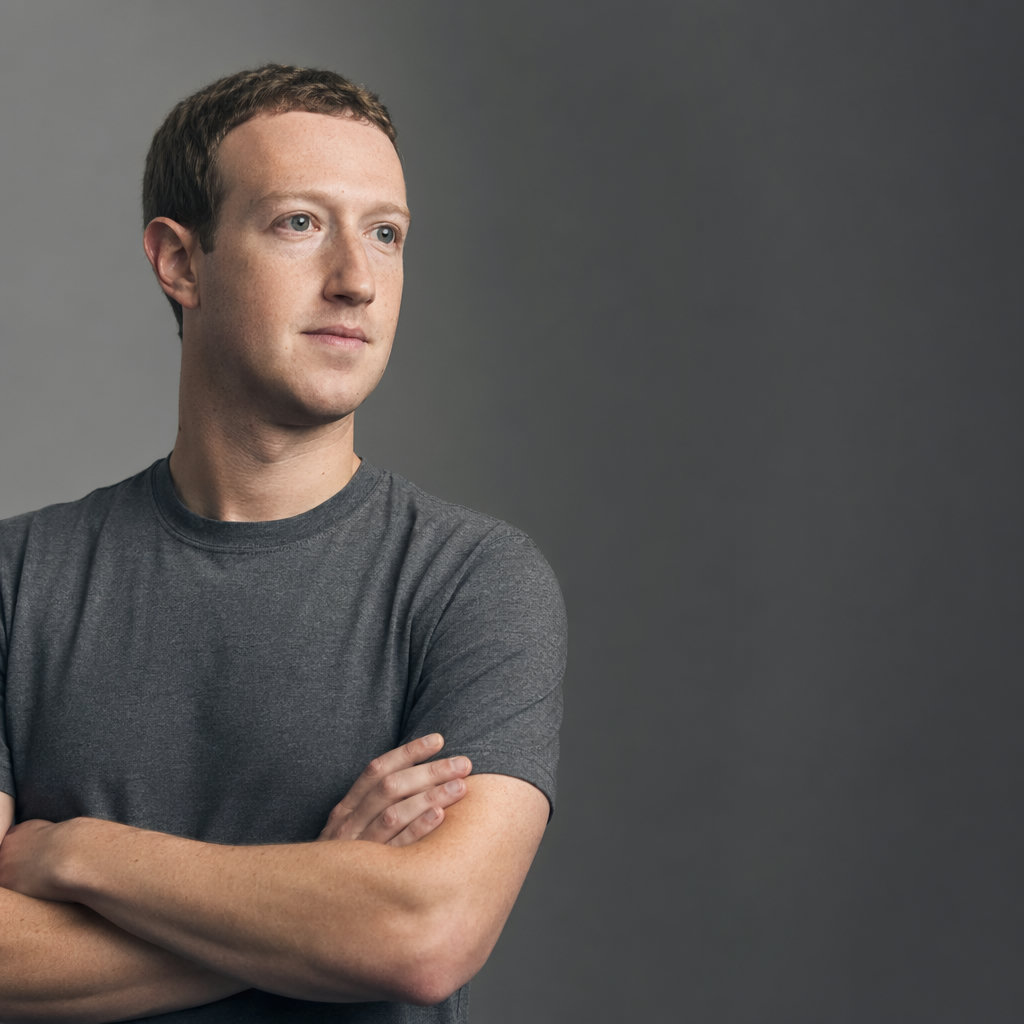

Mark Zuckerberg decidiu que o melhor jeito de treinar o Llama 4 não é apenas minerando a internet pública, mas observando o comportamento de seus próprios talentos. O plano envolve monitorar as atividades dos funcionários em suas ferramentas de trabalho para capturar o que os pesquisadores chamam de "raciocínio de elite".

Mas fica a pergunta: você estaria disposto a trabalhar sabendo que cada erro seu está sendo processado por um algoritmo para, eventualmente, aprender a fazer o seu trabalho melhor do que você? A linha entre produtividade e vigilância algorítmica nunca foi tão tênue na história do Vale do Silício.

O que está em jogo?

> "A escassez de dados de alta qualidade está empurrando as Big Techs para dentro de suas próprias paredes, transformando funcionários em laboratórios vivos para a próxima geração de modelos."

A indústria de IA bateu no muro dos dados. Quase tudo que estava disponível publicamente na web — de posts no Reddit a livros digitalizados — já foi devidamente mastigado pelos modelos atuais. Agora, o desafio é ensinar a IA a resolver problemas complexos que não possuem soluções prontas online.

Para que o Llama evolua, ele precisa entender o processo de pensamento humano por trás da resolução de um bug de software ou de uma estratégia de marketing. Ao monitorar seus funcionários, a empresa de Mark Zuckerberg espera extrair os "rastros de pensamento" que definem a expertise profissional.

Capturar esses dados internamente resolve dois problemas de uma vez: evita processos de direitos autorais de fontes externas e garante que o material de treinamento seja de altíssima qualidade. Afinal, quem melhor para ensinar uma IA sobre engenharia do que os engenheiros que construíram o Facebook?

O caso prático

Na prática, isso significa que ferramentas internas de comunicação e desenvolvimento de software passarão a atuar como sensores gigantescos. Cada interação no ambiente de trabalho corporativo gera metadados valiosos sobre como humanos colaboram, priorizam tarefas e corrigem rotas quando algo dá errado durante um projeto complexo.

"A Meta não está apenas olhando para o resultado final, como um pedaço de código pronto. O interesse real reside no histórico de revisões, nas discussões sobre por que uma solução foi escolhida em detrimento de outra e até nas hesitações documentadas durante o processo criativo.� LEIA_TAMBEM: [Deezer revela que 44% dos uploads diários na plataforma são gerados por IA](https://www.swen.ia.br/noticia/deezer-revela-que-44-dos-uploads-diarios-na-plataforma-sao-gerados-por-ia)

"

Por que isso importa pra você?

Se você acha que isso é um problema exclusivo de quem trabalha em Menlo Park, pense novamente. O que a Meta faz hoje vira o padrão de mercado para o RH de qualquer empresa de tecnologia amanhã. O conceito de "trabalho fantasma" está ganhando uma nova e sofisticada roupagem corporativa.

O monitoramento para treinamento de IA sinaliza uma mudança profunda na relação de trabalho. Se o seu conhecimento está sendo extraído para alimentar uma máquina, o valor do seu emprego pode ser depreciado conforme a ferramenta se torna capaz de replicar suas decisões mais complexas de forma autônoma.

"> {"tipo": "bar", "titulo": "Evolução das Fontes de Dados (2020-2025)", "dados": [{"categoria": "Web Pública", "valor": 85}, {"categoria": "Dados Proprietários", "valor": 45}, {"categoria": "Monitoramento Interno", "valor": 30}, {"categoria": "Dados Sintéticos", "valor": 60}]}� CHART: Fontes de Dados para Treinamento de LLMs

"

Atualmente, existe um movimento de transição onde os dados sintéticos — gerados por outras IAs — estão perdendo o brilho por causarem "colapso de modelo". Isso torna o comportamento humano autêntico, capturado em ambiente controlado, o recurso mais escasso e valioso da economia digital contemporânea.

Dados que impressionam

Estudos indicam que o treinamento com dados de especialistas reais pode aumentar a precisão de modelos de raciocínio lógico em até 40% comparado ao treinamento genérico. É por isso que a empresa está disposta a enfrentar o desgaste interno e possíveis crises de privacidade para garantir essa vantagem competitiva.

"� ANUNCIE_AQUI

"

O detalhe que ninguém viu

Enquanto a maioria das pessoas foca na questão da privacidade, o detalhe crucial é o "RLHF" (Aprendizado por Reforço com Feedback Humano) em escala industrial. A Meta quer automatizar o feedback que antes era feito por contratados externos em países de baixa renda, usando seus próprios especialistas.

Isso cria um ciclo de feedback fechado onde a inteligência da empresa não sai mais das paredes do escritório. Ao contrário do que aconteceu com o GPT-4, que aprendeu muito com o feedback do público geral, a próxima geração do Llama será moldada pela cultura organizacional específica da Meta.

> "Não estamos apenas observando o que os funcionários fazem, estamos tentando codificar a intuição profissional em trilhões de parâmetros matemáticos para que a IA possa simular a experiência de anos em milissegundos."

Esse movimento também serve como um filtro de produtividade. Funcionários que produzem os "melhores dados" para a IA podem acabar sendo os mais valorizados, criando um sistema de incentivo bizarro onde você é premiado por ensinar a máquina que pode, eventualmente, tornar sua função obsoleta no futuro.

Por trás dos bastidores

Rumores internos sugerem que nem todos os setores da Meta receberam a notícia com entusiasmo. Existe um receio legítimo de que o monitoramento constante iniba a criatividade e a experimentação, já que os funcionários podem se sentir pressionados a agir de maneira "perfeita" para não alimentar a IA com erros.

O outro lado da moeda

Do ponto de vista da eficiência, a iniciativa é um xeque-mate. Treinar modelos com dados de altíssima qualidade reduz a necessidade de hardware massivo e diminui as alucinações da IA. Se o modelo aprende com os melhores, ele tende a produzir resultados muito mais confiáveis para o mercado corporativo.

Além disso, a Meta defende que essa prática ajuda a criar assistentes internos muito mais poderosos, capazes de ajudar novos funcionários a se integrarem mais rápido. Imagine um "copiloto" que conhece cada detalhe técnico da empresa porque aprendeu observando os veteranos mais brilhantes durante anos de monitoramento.

"O conflito ético reside na transparência. Até que ponto o funcionário deu consentimento real para ter sua expertise "clonada"? Nas leis trabalhistas atuais, a propriedade intelectual criada durante o expediente pertence à empresa, mas o monitoramento do comportamento pessoal para fins de treinamento de IA é um território jurídico inexplorado.� LEIA_TAMBEM: [CEO do Deutsche Bank destaca alta demanda por IA da Anthropic e alerta sobre regulação](https://www.swen.ia.br/noticia/ceo-do-deutsche-bank-destaca-alta-demanda-por-ia-da-anthropic-e-alerta-sobre-reg)

"

O que poucos sabem

Pouca gente comenta, mas os dados gerados em reuniões de vídeo via Workplace são minas de ouro para o processamento de linguagem natural. A forma como negociamos, resolvemos conflitos e apresentamos ideias são nuances que a IA ainda tem dificuldade de replicar de forma convincente sem esse tipo de exposição.

Quem ganha e quem perde?

No curto prazo, a Meta ganha uma vantagem tecnológica brutal sobre concorrentes que dependem apenas de dados de código aberto. A empresa está criando um ecossistema onde o capital intelectual humano é convertido diretamente em ativos digitais escaláveis e infinitamente reproduzíveis através de seus modelos de linguagem.

Os funcionários, por outro lado, entram em um estado de vigilância permanente. A sensação de "estar sendo assistido" altera o comportamento psicológico e pode levar ao burnout. Trabalhar em um ambiente onde cada erro é registrado para a posteridade algorítmica não é exatamente a definição de um ambiente psicologicamente seguro.

> 🧠 MINDMAP: O Ciclo de Extração de Dados da Meta

> {"central": "Treinamento Interno", "ramos": [{"nó": "Captura", "detalhe": "Screenshots e Logs"}, {"nó": "Processamento", "detalhe": "Extração de Raciocínio"}, {"nó": "Aplicação", "detalhe": "Melhoria do Llama"}, {"nó": "Resultado", "detalhe": "Automação de Tarefas"}]}

Para o mercado, isso pode significar modelos de IA muito mais competentes em tarefas burocráticas e de engenharia. Se a estratégia funcionar, veremos uma explosão de "IAs especialistas" que não apenas falam como humanos, mas que resolvem problemas com a precisão de um engenheiro sênior do Vale do Silício.

"� LEIA_TAMBEM: [SpaceX propõe aquisição da plataforma de IA Cursor por US$ 60 bilhões](https://www.swen.ia.br/noticia/spacex-propoe-aquisicao-da-plataforma-de-ia-cursor-por-us-60-bilhoes)

"

Na prática, funciona?

A grande dúvida é se a IA conseguirá separar o sinal do ruído. Nem todo comportamento humano no trabalho é exemplar. Se o modelo aprender com a procrastinação ou com os processos ineficientes de alguns funcionários, a Meta pode acabar criando uma IA tão burocrática e lenta quanto um comitê corporativo médio.

O que ninguém está dizendo

Existe uma camada geopolítica nessa decisão. Com a China avançando rapidamente no treinamento de modelos com dados de vigilância estatal, as empresas americanas sentem que precisam de métodos igualmente agressivos de coleta de dados para não ficarem para trás na corrida armamentista da inteligência artificial generativa.

A Meta está apenas sendo a primeira a admitir o que muitas outras já fazem de forma velada. Se você usa o Copilot da Microsoft ou as ferramentas do Google Workspace, seus dados já estão ajudando a refinar esses modelos de alguma maneira. A diferença é que a Meta está oficializando isso como estratégia de

core business.

"A jogada de Zuckerberg é clara: transformar a cultura da empresa em um produto. Se ele conseguir codificar o "jeito Meta de fazer as coisas" em um modelo open source ou comercial, ele não estará vendendo apenas software, mas a eficiência operacional de uma das maiores empresas do mundo.� ANUNCIE_AQUI

"

E agora?

O futuro do trabalho parece caminhar para uma simbiose forçada. Ou você aprende a usar a IA para aumentar sua produtividade, ou você se torna o professor involuntário de uma ferramenta que fará seu trabalho amanhã. A transparência sobre esse monitoramento será o grande embate sindical desta década.

O monitoramento da Meta é um sinal de que a era do "ouro digital" fácil acabou. Agora, as empresas precisam minerar as profundezas do comportamento humano para encontrar as pepitas de inteligência que faltam para os modelos atingirem o próximo nível de sofisticação.

E você, aceitaria ser monitorado em tempo integral se isso significasse ter uma IA "gêmea" para fazer as partes chatas do seu trabalho, ou acha que esse é o primeiro passo para o fim da privacidade profissional?

Redação SWEN

Equipe Editorial

A equipe SWEN é formada por especialistas em Inteligência Artificial e tecnologia, trazendo as notícias mais relevantes do setor com análises aprofundadas e linguagem acessível. Nossa missão é democratizar o conhecimento sobre IA para todos os brasileiros.